| 预估时间 | 实际时间 | 准确度 | 代码可读性 |

| 4小时 | 0.5小时 | 100% | 100% |

| 预估时间 | 实际时间 | 准确度 | 代码可读性 |

| 2小时 | 0.05小时 | 90% | 100% |

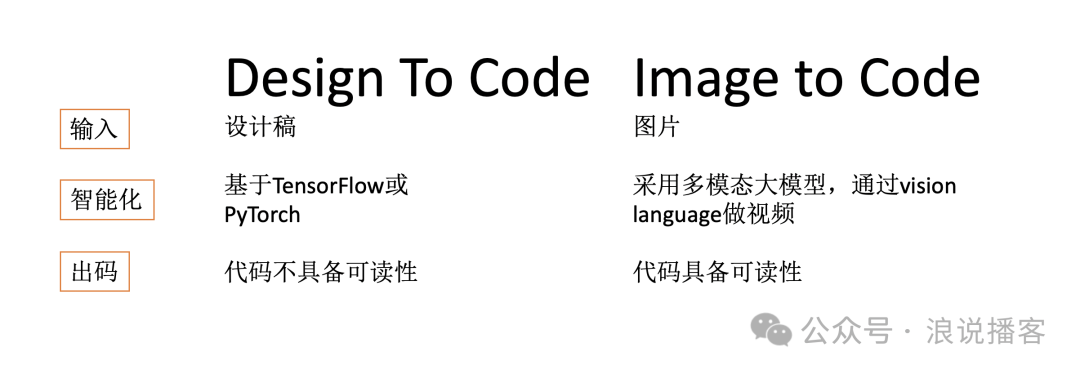

| 对比维度 | TensorFlow | 多模态大模型 |

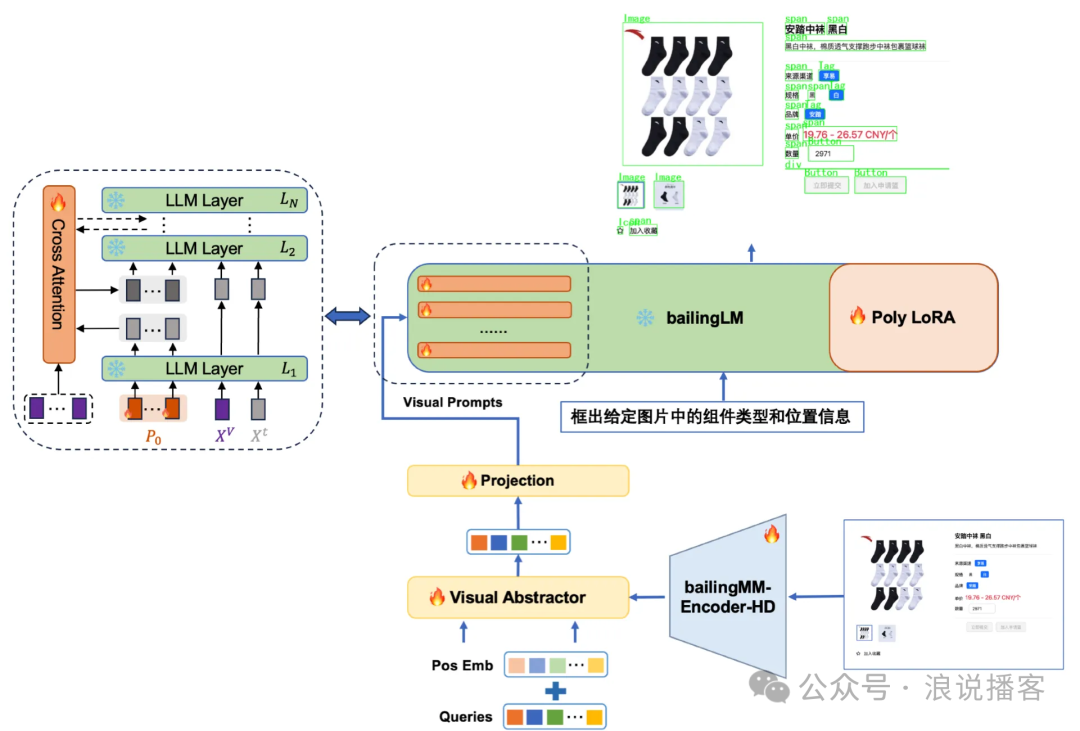

| 核心定位 | • 深度学习框架 • 重要用于开发和训练呆板学习模型 | • 同时处理多种数据(文本、图像、语音、视频等) • 作为通用大模型平台,支持多模态理解与生成 |

| 技术架构 | • 以盘算图 (Graph) 为基础 • 提供高级别 API(如 Keras)和底层 API(图运算) | • 基于大规模 Transformer 或相似架构 • 具备多模态信息融合与对齐机制,能够跨模态理解和生成 |

| 重要功能 | • 自界说建模:可机动构建神经网络 • 高性能加速训练:分布式训练、硬件加速 (GPU/TPU) | • 跨模态交互:文本-图像、文本-语音等 • 零/少样本学习:可快速适配多类任务 |

| 实用场景 | • 盘算机视觉、自然语言处理、语音识别等多类任务 • 通用性强,但须要用户自行设计网络 | • 多模态搜索、内容生成(文本生成、图像生成等) • 同一模型处理多样的输入输出 |

| 学习/推理机制 | • 需用户自行编写训练流程、损失函数、网络布局等 • 偏向强有监督或弱监督训练 | • 具备大规模预训练能力,可以在下游任务中微调或零样本推理 • 借助对比学习、对齐方法进行多模态融合 |

| 依靠生态 | • TensorFlow Serving/Hub 等用于模型部署 • 强大的社区和工具链支持 | • 依靠大规模预训练集群及推理集群 • 仍在快速发展阶段,相关部署和生态尚不及 TensorFlow 成熟 |

| 典范应用 | • 自界说网络训练、学术研究、工业级深度学习应用 • 支持从小模型到大规模分布式训练 | • ChatGPT、DALL·E、Stable Diffusion 等跨模态/大模型应用 • 复杂场景下多模态融合与生成 |

| 欢迎光临 IT评测·应用市场-qidao123.com (https://dis.qidao123.com/) | Powered by Discuz! X3.4 |