- 索引,将传入的记录键快速映射到文件(如果已存在记录键)。索引实现是可插拔的,Bloom过滤器-由于不依赖任何外部系统,因此它是默认配置,索引和数据始终保持同等。Apache HBase-对少量key更高效。在索引标记过程中大概会节省几秒钟。

- 数据,Hudi以两种差别的存储格式存储数据。实际使用的格式是可插入的,但要求具有以下特性–读优化的列存储格式(ROFormat),默认值为Apache Parquet;写优化的基于行的存储格式(WOFormat),默认值为Apache Avro。

为什么Hudi对于大规模和近实时应用很紧张?

Hudi办理了以下限制

- HDFS的可伸缩性限制

- 需要在Hadoop中更快地呈现数据

- 没有直接支持对现有数据的更新和删除

- 快速的ETL和建模

- 要检索全部更新的记录,无论这些更新是添加到最近日期分区的新记录还是对旧数据的更新,Hudi都允许用户使用最后一个检查点时间戳。此过程不用执行扫描整个源表的查询

Hudi的优势

- HDFS中的可伸缩性限制。

- Hadoop中数据的快速呈现

- 支持对于现有数据的更新和删除

- 快速的ETL和建模

(以上内容主要引用于:Apache Hudi 详解_风中云彩的博客-CSDN博客)

新架构与湖仓一体

通过湖仓一体、流批一体,准实时场景下做到了:数据同源、同计算引擎、同存储、同计算口径。数据的时效性可以到分钟级,能很好的满足业务准实时数仓的需求。下面是架构图:

MySQL 数据通过 Flink CDC 进入到 Kafka。之以是数据先入 Kafka 而不是直接入 Hudi,是为了实现多个实时使命复用 MySQL 过来的数据,避免多个使命通过 Flink CDC 接 MySQL 表以及 Binlog,对 MySQL 库的性能造成影响。

通过 CDC 进入到 Kafka 的数据除了落一份到离线数据堆栈的 ODS 层之外,会同时按照实时数据堆栈的链路,从 ODS->DWD->DWS->OLAP 数据库,最后供报表等数据服务使用。实时数仓的每一层结果数据会准实时的落一份到离线数仓,通过这种方式做到步伐一次开辟、指标口径统一,数据统一。

从架构图上,可以看到有一步数据修正 (重跑汗青数据) 的动作,之以是有这一步是思量到:有大概存在由于口径调解大概前一天的实时使命计算结果错误,导致重跑汗青数据的情况。

而存储在 Kafka 的数据有失效时间,不会存太久的汗青数据,重跑好久的汗青数据无法从 Kafka 中获取汗青源数据。再者,如果把大量的汗青数据再一次推到 Kafka,走实时计算的链路来修正汗青数据,大概会影响当天的实时作业。以是针对重跑汗青数据,会通过数据修正这一步来处置惩罚。

总体上说,这个架构属于 Lambda 和 Kappa 混搭的架构。流批一体数据堆栈的各个数据链路有数据质量校验的流程。第二天对前一天的数据进行对账,如果前一天实时计算的数据无非常,则不需要修正数据,Kappa 架构已经充足。

(本节内容,引用自:37 手游基于 Flink CDC + Hudi 湖仓一体方案实践)

最佳实践

版本搭配

版本选择,这个问题大概会成为困扰大家的第一个绊脚石,下面是hudi中文社区推荐的版本适配:

flinkhudi1.12.20.9.01.13.10.10.0 官方说的支持版本是这样, 不过如今我的1.13和0.10组合并没有配置成功,以是大家还是只管选择 1.12.2+0.9.0 吧,配合scala 2.11 。

下载hudi

https://mvnrepository.com/artifact/org.apache.hudi/hudi-flink-bundle

执行

如果将 hudi-flink-bundle_2.11-0.9.0.jar 放到了 flink/lib 下,则只需要如下执行即可,否则会出现各种找不到类的非常

bin/sql-client.sh embedded

Flink on hudi

新建maven工程,修改pom如下

我们通过构建查询insert into t2 select replace(uuid(),'-',''),id,name,description,now() from mysql_binlog 将创建的mysql表,插入到hudi里。

- package name.lijiaqi;

-

- import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

- import org.apache.flink.table.api.EnvironmentSettings;

- import org.apache.flink.table.api.SqlDialect;

- import org.apache.flink.table.api.TableResult;

- import org.apache.flink.table.api.bridge.java.StreamTableEnvironment;

-

- public class MysqlToHudiExample {

- public static void main(String[] args) throws Exception {

- EnvironmentSettings fsSettings = EnvironmentSettings.newInstance()

- .useBlinkPlanner()

- .inStreamingMode()

- .build();

- StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

- env.setParallelism(1);

- StreamTableEnvironment tableEnv = StreamTableEnvironment.create(env, fsSettings);

-

- tableEnv.getConfig().setSqlDialect(SqlDialect.DEFAULT);

-

- // 数据源表

- String sourceDDL =

- "CREATE TABLE mysql_binlog (\n" +

- " id INT NOT NULL,\n" +

- " name STRING,\n" +

- " description STRING\n" +

- ") WITH (\n" +

- " 'connector' = 'jdbc',\n" +

- " 'url' = 'jdbc:mysql://127.0.0.1:3306/test', \n"+

- " 'driver' = 'com.mysql.jdbc.Driver', \n"+

- " 'username' = 'root',\n" +

- " 'password' = 'dafei1288', \n" +

- " 'table-name' = 'test_cdc'\n" +

- ")";

-

- // 输出目标表

- String sinkDDL =

- "CREATE TABLE t2(\n" +

- "\tuuid VARCHAR(20),\n"+

- "\tid INT NOT NULL,\n" +

- "\tname VARCHAR(40),\n" +

- "\tdescription VARCHAR(40),\n" +

- "\tts TIMESTAMP(3)\n"+

- // "\t`partition` VARCHAR(20)\n" +

- ")\n" +

- // "PARTITIONED BY (`partition`)\n" +

- "WITH (\n" +

- "\t'connector' = 'hudi',\n" +

- "\t'path' = 'hdfs://172.19.28.4:9000/hudi_t4/',\n" +

- "\t'table.type' = 'MERGE_ON_READ'\n" +

- ")" ;

- // 简单的聚合处理

- String transformSQL =

- "insert into t2 select replace(uuid(),'-',''),id,name,description,now() from mysql_binlog";

-

- tableEnv.executeSql(sourceDDL);

- tableEnv.executeSql(sinkDDL);

- TableResult result = tableEnv.executeSql(transformSQL);

- result.print();

-

- env.execute("mysql-to-hudi");

- }

- }

- package name.lijiaqi;

-

- import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

- import org.apache.flink.table.api.EnvironmentSettings;

- import org.apache.flink.table.api.SqlDialect;

- import org.apache.flink.table.api.TableResult;

- import org.apache.flink.table.api.bridge.java.StreamTableEnvironment;

-

- public class ReadHudi {

- public static void main(String[] args) throws Exception {

- EnvironmentSettings fsSettings = EnvironmentSettings.newInstance()

- .useBlinkPlanner()

- .inStreamingMode()

- .build();

- StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

- env.setParallelism(1);

- StreamTableEnvironment tableEnv = StreamTableEnvironment.create(env, fsSettings);

-

- tableEnv.getConfig().setSqlDialect(SqlDialect.DEFAULT);

-

- String sourceDDL =

- "CREATE TABLE t2(\n" +

- "\tuuid VARCHAR(20),\n"+

- "\tid INT NOT NULL,\n" +

- "\tname VARCHAR(40),\n" +

- "\tdescription VARCHAR(40),\n" +

- "\tts TIMESTAMP(3)\n"+

- // "\t`partition` VARCHAR(20)\n" +

- ")\n" +

- // "PARTITIONED BY (`partition`)\n" +

- "WITH (\n" +

- "\t'connector' = 'hudi',\n" +

- "\t'path' = 'hdfs://172.19.28.4:9000/hudi_t4/',\n" +

- "\t'table.type' = 'MERGE_ON_READ'\n" +

- ")" ;

- tableEnv.executeSql(sourceDDL);

- TableResult result2 = tableEnv.executeSql("select * from t2");

- result2.print();

-

- env.execute("read_hudi");

- }

- }

Flink CDC 2.0 on Hudi

添加依赖

添加如下依赖到$FLINK_HOME/lib下

- hudi-flink-bundle_2.11-0.10.0-SNAPSHOT.jar (修改 Master 分支的 Hudi Flink 版本为 1.13.2 然后构建)

- hadoop-mapreduce-client-core-2.7.3.jar (办理 Hudi ClassNotFoundException)

- flink-sql-connector-mysql-cdc-2.0.0.jar

- flink-format-changelog-json-2.0.0.jar

- flink-sql-connector-kafka_2.11-1.13.2.jar

留意,在探求jar的时候,cdc 2.0 更新过group id ,不再试 com.alibaba.ververica 而是改成了 com.ververica

flink sql cdc on hudi

创建mysql cdc表

- CREATE TABLE mysql_users (

- id BIGINT PRIMARY KEY NOT ENFORCED ,

- name STRING,

- birthday TIMESTAMP(3),

- ts TIMESTAMP(3)

- ) WITH (

- 'connector' = 'mysql-cdc',

- 'hostname' = 'localhost',

- 'port' = '3306',

- 'username' = 'root',

- 'password' = 'dafei1288',

- 'server-time-zone' = 'Asia/Shanghai',

- 'database-name' = 'test',

- 'table-name' = 'users'

- );

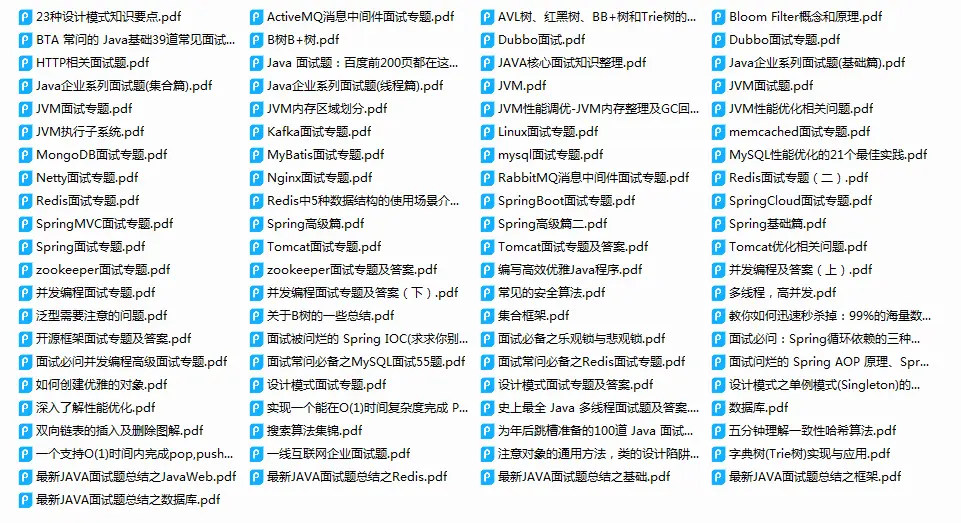

- # **写在最后**

- 为了这次面试,也收集了很多的面试题!

- 以下是部分面试题截图

-

- Y NOT ENFORCED ,

- name STRING,

- birthday TIMESTAMP(3),

- ts TIMESTAMP(3)

- ) WITH (

- 'connector' = 'mysql-cdc',

- 'hostname' = 'localhost',

- 'port' = '3306',

- 'username' = 'root',

- 'password' = 'dafei1288',

- 'server-time-zone' = 'Asia/Shanghai',

- 'database-name' = 'test',

- 'table-name' = 'users'

- );

- # **写在最后**

- 为了这次面试,也收集了很多的面试题!

- 以下是部分面试题截图

- [外链图片转存中...(img-eEI9zNAD-1723525790091)]

|